Αγαπητέ αναγνώστη, γνωρίζεις ότι η τεχνητή νοημοσύνη (AI) γνώριζε ήδη, πριν αποφασίσετε, ότι σήμερα θα διάβαζες την Πυξίδα και πιθανώς αυτό το άρθρο; Αυτή είναι η ουσία ενός υποβλητικού άρθρου, υπογεγραμμένου από τους ερευνητές του Cambridge Yaqub Chaudhary και Jonnie Penn, με τίτλο Προσοχή στην οικονομία της πρόθεσης: συλλογή και εμπορευματοποίηση της πρόθεσης μέσω μεγάλων γλωσσικών μοντέλων που δημοσιεύθηκε στις 30 Δεκεμβρίου.

Οι δύο μελετητές λένε ότι μεταβαίνουμε από την οικονομία της προσοχής στην οικονομία της πρόθεσης. Όσον αφορά το πρώτο, είναι γνωστό ότι οι ιστότοποι, τα κοινωνικά δίκτυα, οι συνομιλίες κ.λπ. καταγράφουν αυτά που παρακολουθούμε, βλέπουμε, αγοράζουμε και στέλνουμε αυτά τα μεγάλα δεδομένα σε εταιρείες έτσι ώστε με διαφημίσεις, προτεινόμενα άρθρα κ.λπ. να καθοδηγούν τις αγορές μας, ενισχυμένες από τη γνώση για τα γούστα μας που διαθέτουν. Τώρα ένα επόμενο βήμα βρίσκεται σε εξέλιξη: η τεχνητή νοημοσύνη θα προβλέπει τις προθέσεις μας. Δεν είναι πλέον απλώς θέμα παρατήρησης αυτού που παρατηρούμε, αλλά αλληλεπίδρασης μαζί μας για να γνωρίσουμε καλύτερα τον εαυτό μας και να προβλέψουμε τις κινήσεις μας. Και πώς αλληλεπιδρά η τεχνητή νοημοσύνη μαζί μας; Με προσωπικούς βοηθούς ή ψηφιακούς βοηθούς (έξυπνους βοηθούς) – σκεφτείτε τον βοηθό Google ή την Alexa ή τη Siri – και με bots συνομιλίας, δηλαδή λογισμικό προγραμματισμένο να μιλάει σε εμάς τους ανθρώπους. Και τα δύο συστήματα καταγράφουν έναν τεράστιο όγκο πληροφοριών για εμάς: επιλογές, προτιμήσεις και συνήθειες που σχετίζονται με τον τρόπο ζωής, την κατανάλωση, τα ενδιαφέροντα, τις συναισθηματικές καταστάσεις, πού βρισκόμαστε, ποιον συναντάμε, τι διαβάζουμε κ.λπ. Τα καταγράφουν με μεγάλη ακρίβεια και για μεγάλα χρονικά διαστήματα επειδή μιλάμε μεταξύ μας, αλληλεπιδρούμε μαζί τους συνεχώς και για πολλούς σκοπούς. Εν ολίγοις, αυτοί οι προσωπικοί βοηθοί και τα bots συνομιλίας μας γνωρίζουν καλύτερα από το Facebook.

Και φτάνουμε στο σημείο: όλος αυτός ο πλούτος γνώσεων για εμάς θα χρησιμοποιηθεί από την τεχνητή νοημοσύνη για να προβλέψει τις επιλογές μας και να μας τις προτείνει πριν τις κάνουμε: από την επιθυμία σε αυτό που θα θέλαμε να επιθυμήσουμε. Το άρθρο δίνει αυτό το παράδειγμα στο οποίο ένας φωνητικός βοηθός αλληλεπιδρά με τον χρήστη με αυτόν τον τρόπο: "Είπατε ότι αισθάνεστε καταπονημένοι, πρέπει να κλείσω αυτό το εισιτήριο κινηματογράφου για το οποίο μιλήσαμε;" Και γιατί να σταματήσουμε στον κινηματογράφο; Πιθανοί διάλογοι, που εφευρέθηκαν από εμάς, είναι επίσης οι εξής: «Είπες ότι βαρέθηκες τη γυναίκα σου. Έχετε σκεφτεί ποτέ μια νέα ζωή χωρίς αυτήν; Είσαι ακόμα νέος". «Είσαι έγκυος, είναι το δεύτερο παιδί σου, συν το ότι εσύ και ο σύντροφός σου πρέπει ακόμα να ολοκληρώσετε την πληρωμή του στεγαστικού δανείου. Έχετε σκεφτεί ποτέ την άμβλωση; Αν θέλετε, θα σας διαβάσω μερικά άρθρα σχετικά με το θέμα».

Φυσικά, η πρόταση δεν θα προέλθει τόσο από την τεχνητή νοημοσύνη, αλλά από εταιρείες ή μεγάλα μέσα ενημέρωσης ή ομάδες πολιτικής εξουσίας που έχουν πουλήσει ή μας έχουν δώσει ψηφιακούς βοηθούς που υπάρχουν στο smartphone μας ή στο σπίτι μας. Έτσι, αν κάποτε τα δεδομένα για εμάς άξιζαν χρυσό, τώρα αυτό που είναι πολύτιμο είναι οι προθέσεις μας. «Αυτές οι εταιρείες», προσθέτουν οι δύο ερευνητές, «πωλούν ήδη την προσοχή μας. Για να αποκτήσουμε ένα εμπορικό πλεονέκτημα, το επόμενο λογικό βήμα είναι να χρησιμοποιήσουμε την τεχνολογία, την οποία προφανώς ήδη αναπτύσσουν, για να προβλέψουμε τις προθέσεις μας και να πουλήσουμε τις επιθυμίες μας πριν καν κατανοήσουμε πλήρως ποιες είναι.

Είναι αυτονόητο ότι, όπως μπορεί να μαντέψει κανείς από τα παραπάνω παραδείγματα, το βήμα από την «πρόταση» στη «χειραγώγηση» είναι πολύ σύντομο. Οι ερευνητές του Κέντρου Leverhulme για το Μέλλον της Νοημοσύνης (LCFI) στο Cambridge μιλούν για «πειστικές τεχνολογίες», για να το θέσουμε ήπια. Η τεχνητή νοημοσύνη που υπάρχει σε αυτές τις τεχνολογίες θα δημιουργήσει σχέσεις εμπιστοσύνης και κατανόησης μαζί μας και έτσι θα πειστούμε να ακολουθήσουμε τις προτάσεις της. Εν ολίγοις: Η τεχνητή νοημοσύνη θα αποφασίσει για εμάς, ακόμα κι αν δεν το συνειδητοποιούμε. Από την πληροφορία, στην υποβολή, στη μοντελοποίηση της συνείδησής μας και της συλλογικής.

Οι δύο μελετητές είναι πολύ σαφείς από αυτή την άποψη: «τέτοια εργαλεία αναπτύσσονται ήδη για να διεγείρουν, να συμπεράνουν, να συλλέξουν, να καταγράψουν, να κατανοήσουν, να προβλέψουν και, τελικά, να χειραγωγήσουν, να διαμορφώσουν και να εμπορευματοποιήσουν ανθρώπινα σχέδια και σκοπούς, τόσο ασήμαντα (π.χ. η επιλογή ενός ξενοδοχείου) όσο και βαθιά (π.χ. η επιλογή ενός πολιτικού υποψηφίου)».

Όλα αυτά δεν είναι μέλλον, αλλά παρόν. Οι προγραμματιστές του App Intents της Apple για τη σύνδεση εφαρμογών με τη Siri (προσωπική βοηθό της Apple) συμπεριέλαβαν πρωτόκολλα στην εφαρμογή για να «προβλέψουν τις ενέργειες που μπορεί να κάνει κάποιος στο μέλλον [και] να υποδείξουν την πρόθεση που διατυπώνεται από την εφαρμογή».

Οι επιπτώσεις αυτής της διαδικασίας, η οποία θα οδηγήσει από το προγνωστικό στο κανονιστικό, είναι ατελείωτες. Ακόμη και στον βιοηθικό τομέα. Τον Ιανουάριο του περασμένου έτους, το ακόλουθο άρθρο δημοσιεύθηκε στο επιστημονικό περιοδικό The American Journal of Bioethics: A personalized predictor of patient preferences for υποκατάστατες κρίσεις στην υγειονομική περίθαλψη: τεχνικά εφικτό και ηθικά επιθυμητό.

Τι πρέπει να κάνετε όταν ένας ασθενής δεν είναι πλέον ικανός να κατανοήσει και να θέλει; Ναι, υπάρχουν εκ των προτέρων δηλώσεις θεραπείας (DAT). Τι θα γινόταν όμως αν έλειπαν; Και, ακόμα κι αν υπήρχαν, τι θα γινόταν αν ήταν σκοτεινές, διφορούμενες, ελλιπείς; Ναι, υπάρχει ο αριθμός του διαχειριστή. Αλλά αν και αυτός απουσίαζε ή, ακόμα κι αν το έκανε, ποιος λέει ότι είναι αξιόπιστος στην περιγραφή της θέλησης του ασθενούς; Με παρόμοιο τρόπο αν σκεφτούμε συγγενείς. Εδώ είναι που η τεχνητή νοημοσύνη έρχεται στη διάσωση, η οποία, στην περίπτωση αυτή, παίρνει το όνομα του εξατομικευμένου προγνωστικού των προτιμήσεων των ασθενών: το μοντέλο 4P.

Οι συντάκτες του προαναφερθέντος άρθρου προτείνουν «τη χρήση μηχανικής μάθησης για την εξαγωγή των αξιών ή των προτιμήσεων των ασθενών από δεδομένα που λαμβάνονται σε ατομικό επίπεδο και παράγονται κυρίως από τους ίδιους, στα οποία οι προτιμήσεις τους είναι πιθανό να κωδικοποιηθούν (έστω και σιωπηρά)». Για να απλοποιήσουμε και να παραδειγματιστούμε: έχετε ένα ατύχημα και καταλήγετε σε κώμα. Οι γιατροί ρωτούν την Alexa τι επιλογή θα κάνατε σε εκείνη τη συγκυρία. Αρχικά, η Alexa συγκεντρώνει όλες τις αναγνώσεις και τα βίντεό σας σχετικά με το θέμα της ευθανασίας που μπορεί να σας άρεσαν, καθώς και συνομιλίες που είχατε μαζί της ή με άλλους σχετικά με αυτό το θέμα. Δεύτερον, συγκρίνει αυτό το πακέτο δεδομένων με την κάπως σκιώδη ιδιοσυγκρασία σας και τη στάση σας απέναντι στη ζωή που δεν είναι πάντα ηλιόλουστη, έτσι ερμηνεύεται λόγω των ταινιών, των αναγνώσεων, των ενδιαφερόντων που καλλιεργείτε, των μηνυμάτων ηλεκτρονικού ταχυδρομείου και των αναρτήσεων που γράψατε, των φωτογραφιών ηλιοβασιλέματος που δημοσιεύτηκαν στο Instagram, των αγορών ρούχων γοτθικού λυκόφωτος στο Amazon, από μερικές ατυχείς φράσεις ενός χαρακτήρα Leopardian που εκσφενδονίζετε ενάντια στον Ουρανό και υπαγορεύονται από μια περαστική απελπισία. Και έτσι, τελικά, σε ένα δισεκατομμυριοστό του δευτερολέπτου βρίσκεστε σε ένα φέρετρο επειδή η Alexa το αποφάσισε. Ή μάλλον: ποιος προγραμμάτισε την Alexa. Και δεν έχει σημασία αν θα μπορούσατε επίσης να αποφασίσετε διαφορετικά από τις προηγούμενες αποφάσεις σας σε εκείνη τη συγκυρία, δεδομένου ότι «οι υποθετικές καταστάσεις δεν αντικατοπτρίζουν απαραίτητα αυτό που επιλέγουν οι άνθρωποι σε πραγματικές καταστάσεις».

Διαβάζοντας και τα δύο άρθρα, τότε καταλαβαίνουμε ότι λαμβάνει χώρα μια ανθρωπολογική υποστροφή: το εικονικό αρχικά μας ενημέρωσε, στη συνέχεια μας βοήθησε και στο εγγύς μέλλον θα μας αντικαταστήσει. Από τις πληροφορίες, στη βοήθεια, στην αντικατάσταση. Στην πραγματικότητα, οι ερευνητές που πρότειναν το μοντέλο 4Ps λένε ότι η τεχνητή νοημοσύνη θα γίνει «ένα είδος «ψηφιακού ψυχολογικού δίδυμου» του ατόμου». Η ελευθερία μας, ήδη σε μεγάλο βαθμό θύμα λογοκλοπής σήμερα με πολλούς τρόπους, θα παραδιδόταν σε εκείνους που χειρίζονται την τεχνητή νοημοσύνη και οι τελευταίοι θα επέλεγαν για εμάς αν θα πάμε στον κινηματογράφο, ποιον θα παντρευτούμε και αν θα τραβήξουμε την πρίζα. Θα δίναμε πλήρη εξουσιοδότηση στην τεχνητή νοημοσύνη επειδή στη συλλογική αντίληψη η τελευταία είναι εξαιρετικά έξυπνη, ουδέτερη στις κρίσεις, αντικειμενική επειδή είναι απαλλαγμένη από συναισθηματικές ρυθμίσεις και προσωπικά ενδιαφέροντα. Το αποτέλεσμα θα ήταν μοιραίο: δεν θα ζούσαμε πλέον εμείς, αλλά ο εικονικός μας εαυτός.

1 σχόλιο:

... ἔτσι ὅπως τὰ λέει εἶναι...

ὅμως, πρὶν νὰ τρομοκρατηθοῦμε γιὰ τὸ αὔριο ποὺ εἶναι ἤδη ἐδῶ απὸ...προχθές,

(δυό κλὶκ λιγότερο φοβερό)

ἀς ἀναρωτηθοῦμε, ἀν θὰ ἦταν πράγματι τόσο χειρότερη ὅσο μᾶς λέγαν ἡ ζωή μας

ἅμα τὴν εἴχαμε περιορίσει στὰ

πραγματικά ἀ π α ρ α ί τ η τ α

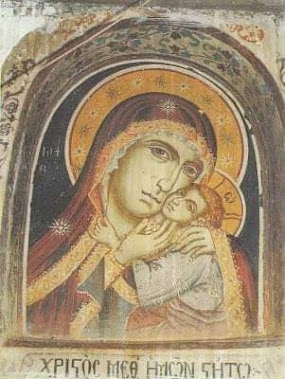

καὶ ἡ ἐκκλησία μας, μᾶς δίνει τὸν πιὸ ταιριαστό στὴν φκιάξη μας τρόπο, γιὰ νὰ τὸ παλαίψουμε

καὶ ἔχοντας πάντοτε ὡς σταθερή ἐ γ γ ύ η σ η

τὸ ἔλεος τοῦ Θεοῦ... !

ἔτσι κι ἀλλοιῶς, οἱ πολλοί, ἔχουν κάνει ἤδη αυτό ποὺ θεωροῦν ... "ἐπιλογή" τους...

δικαίωμά τους λοιπὸν νὰ τὸ ἀκολουθήσουν

(μὲ τὸν Θεό νὰ εἶναι πάντα ἐκεῖ νὰ... τοὺς ψιλοχαλάει τὶς ψευδαισθήσεις...

τὶς... δικές τους τὶς ἄφθονες καὶ τὶς δικές μας... τὶς... ὄχι λίγες... ἀκόμα... ! )

Δημοσίευση σχολίου